Parecen los anuncios de https://twitter.com/matthew_d_green/status/142307. 1186616000513? S = 20, experto en criptografía, son algo exactos. En efecto, Apple acaba de anunciar el despliegue de nuevas funciones destinadas a proteger a los niños y prevenir todo tipo de abusos o ataques por parte de depredadores sexuales.

Estas son funciones de sus plataformas destinadas a proteger a los niños, incluido un sistema capaz de detectar pornografía infantil en iCloud. preservando la privacidad del usuario. Estos incluyen tres áreas: iMessage, Siri, iCloud. Estas herramientas debutarán a finales de año., en actualizaciones para iOS 15, iPadOS 15, macOS Monterey y watchOS 8.

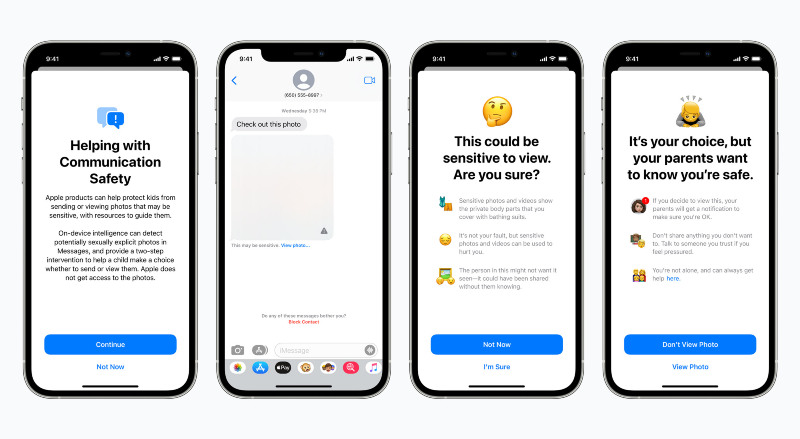

En primer lugar, La aplicación iMessages en iPhone, iPad y Mac obtendrá una nueva función de seguridad de las comunicaciones para alertar a los niños y a sus padres cuando reciban o envíen fotos sexualmente explícitas. Apple dijo que la aplicación Mensajes utilizará el aprendizaje automático para analizar los archivos adjuntos, y si se descubre que una foto es sexualmente explícita, la foto se borrará automáticamente y se notificará al niño.

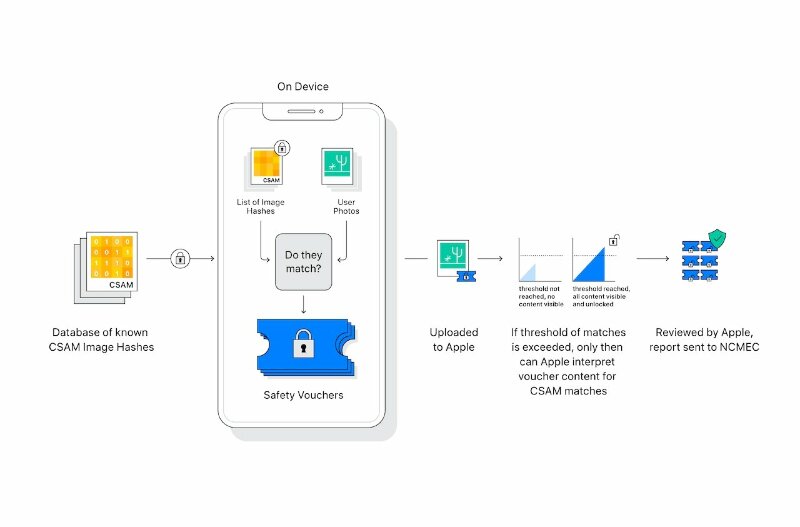

A partir de este año (con iOS 15 y iPadOS 15), Apple podrá detectar imágenes que contengan características de abuso sexual infantil (Material de abuso sexual infantil -CSAM) almacenados en Fotos en iCloud, lo que permitirá a Apple informar estos casos al Centro Nacional para Niños Desaparecidos y Explotados (NCMEC), una organización sin fines de lucro que trabaja en conjunto con las agencias de aplicación de la ley de EE. UU. Apple también insiste en que el análisis se realizará solo en las fotos almacenadas en iCloud y no en el iPhone.

La tecnología, llamada NeuralHash, permite analizar una imagen. El objetivo principal es garantizar que las imágenes idénticas y visualmente similares den como resultado el mismo código, mientras que las imágenes que difieren entre sí dan como resultado diferentes hashes, dijo la firma en un nuevo documento técnico. Protecciones extendidas para niños.

Finalmente, estas herramientas se extenderán en Siri y Search, siempre con el objetivo de mejorar la seguridad de los niños y sus padres en línea.. Para Siri será posible pedir ayuda o cómo denunciar un caso sospechoso y obtener ayuda en situaciones peligrosas. Siri luego brindará consejos y recursos para administrarlo de la mejor manera posible. En el lado de la investigación, en caso de consultas sobre contenido pedófilo, se informará a los usuarios que el interés en este tema es dañino y problemático, y se les proporcionarán recursos de socios para obtener ayuda sobre este tema.

Este sistema es promocionada como una tecnología para prevenir delitos sexuales, pero plantea preguntas obvias sobre la privacidad, privacidad o vigilancia de millones de teléfonos. Como señala Matthew Green, este tipo de herramienta puede ser una fuerza para rastrear la pornografía infantil en los teléfonos. Pero, ¿imagina lo que podría hacer en manos de un gobierno autoritario? Más allá de eso, el uso de tal técnica puede ser sorprendente por parte de Apple, que siempre ha defendido la privacidad, negándose a desbloquear iPhones en casos criminales, como el de San Bernardino, a menos que un juez lo obligue a hacerlo.

Pero Apple insiste en este punto: la monitorización y abuso de sistemas siempre ha sido una de sus principales preocupaciones, Cupertino asegura tener diseñó cada una de estas nuevas funciones para garantizar la privacidad mientras se combate el abuso o la explotación infantil en línea.

Protecciones ampliadas para niños