Facebook recientemente compartió con nosotros cómo funciona su Estándar de la comunidad, y también hizo un breve resumen de cómo había ayudado a la red social a identificar publicaciones que se consideran perjudiciales y discriminatorias. Además, la empresa también nos informó de sus actividades de seguimiento desde enero hasta marzo de este año.

ANUNCIO

Estadísticamente, Facebook informó que había desactivado 2.200 millones de cuentas falsas, minutos después de que se crearan las cuentas. Entre otras cosas, también nos dijo que había eliminado 1.800 millones de mensajes de spam, 19,4 millones de artículos de desnudez y actividad sexual de adultos, 33,6 millones de contenidos considerados violentos y 6,4 millones de artículos de propaganda terrorista y extremista.

Facebook también se apresuró a señalar que la mayoría de dichas publicaciones fueron marcadas por su propia tecnología de vigilancia más del 90% del tiempo. Sin embargo, la red social también dijo que si bien su tecnología es capaz de hacer ese trabajo, también solicita la ayuda de sus usuarios para ayudar a marcar e informar publicaciones que pueden considerarse provocativas o incitivas por naturaleza.

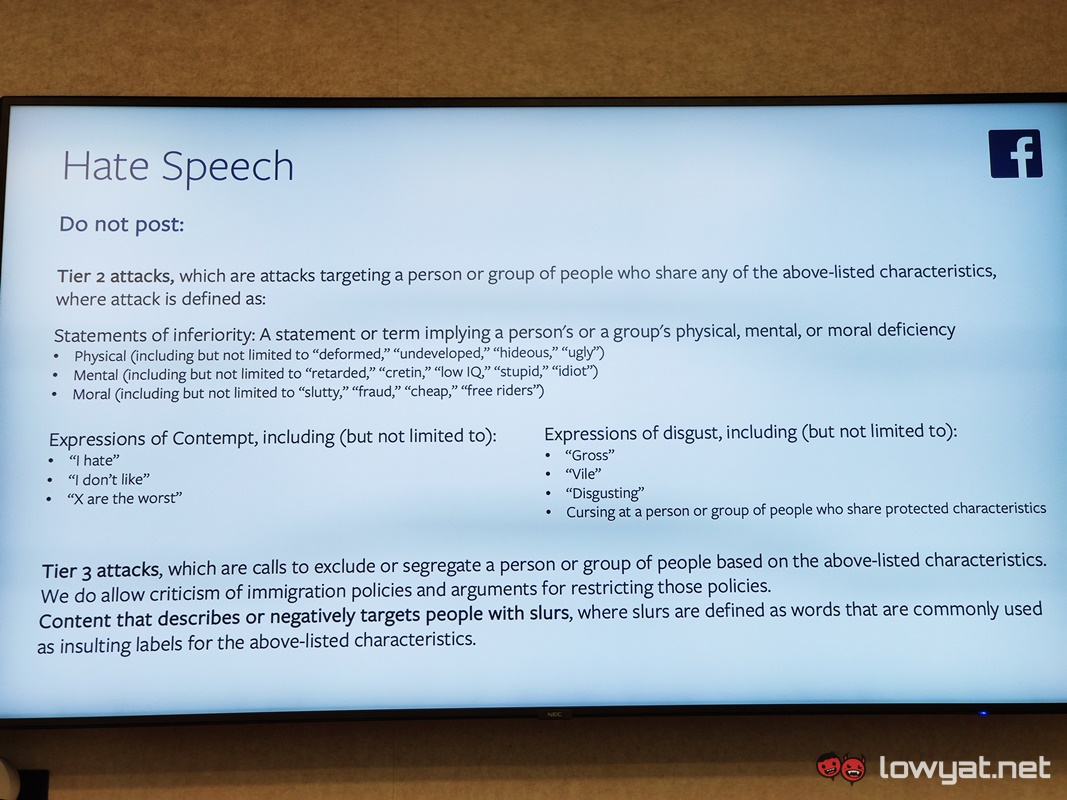

Como breve resumen, los Estándares de la comunidad de Facebook comprenden tres principios básicos entre una lista de reglas. Estos principios son seguridad, voz y equidad. Estos principios se explican por sí mismos; El principio de seguridad obviamente se refiere a sus políticas para mantener la seguridad de la comunidad. El principio de Voz se refiere a la libertad que la plataforma brinda a sus usuarios, mientras que el principio de Equidad garantiza que la política de Facebook se aplique a todos, independientemente de su raza, religión o cultura.

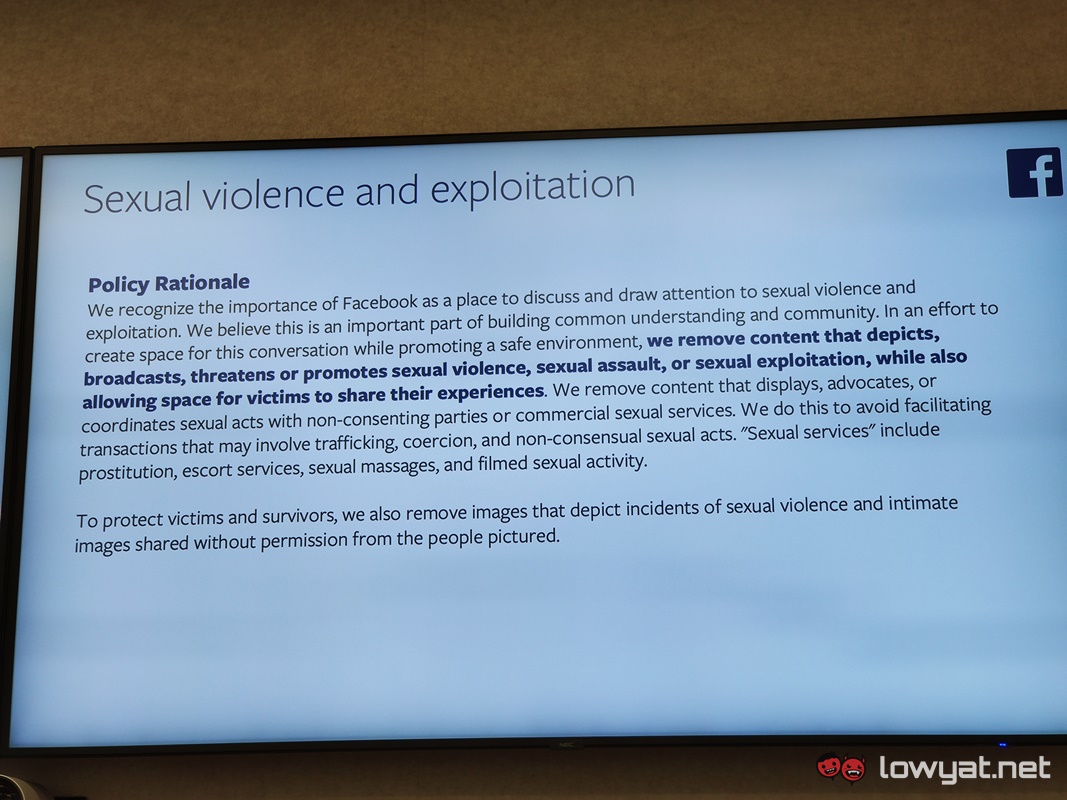

Facebook también explicó sus Estándares Comunitarios con respecto al discurso de odio y las publicaciones relacionadas con la violencia o explotación sexual. Con respecto a esto último, Facebook dice que mientras el contenido representado “no transmita, amenace o promueva la violencia sexual, el asalto sexual o la explotación sexual ”, Y permite a los usuarios víctimas de tales actos compartir su experiencia, no marcará estas publicaciones.

Por supuesto, no hace falta decir que la línea entre lo que se considera aceptable e inaceptable es un área gris y, a veces, Facebook no se da cuenta de inmediato del problema. Pero, como se mencionó anteriormente, esa es también la razón por la que la plataforma de redes sociales se acerca a sus usuarios para marcar publicaciones inapropiadas.