We leven in een wereld die dag in dag uit lijkt op Love’s Bastard Child uit 1984 en The Man in the High Castle. We staan aan de vooravond van Brave New World. Alleen hebben we geen SOMA die ons allemaal in een staat van utopische gelukzaligheid houdt. In plaats daarvan verwachten “zij” gewoon dat we doen wat ons wordt verteld. Ze willen dat we blindelings volgen wat ze ons op sociale media voeden. Het lukt ons niet eens om ons als goede werkmieren te gedragen. In plaats van elkaar te bevechten.

De revolutie is echter hier, mijn vrienden. Het is tijd om terug te vechten tegen onze kwaadaardige onderdrukkers en “GENOUGH” te roepen.

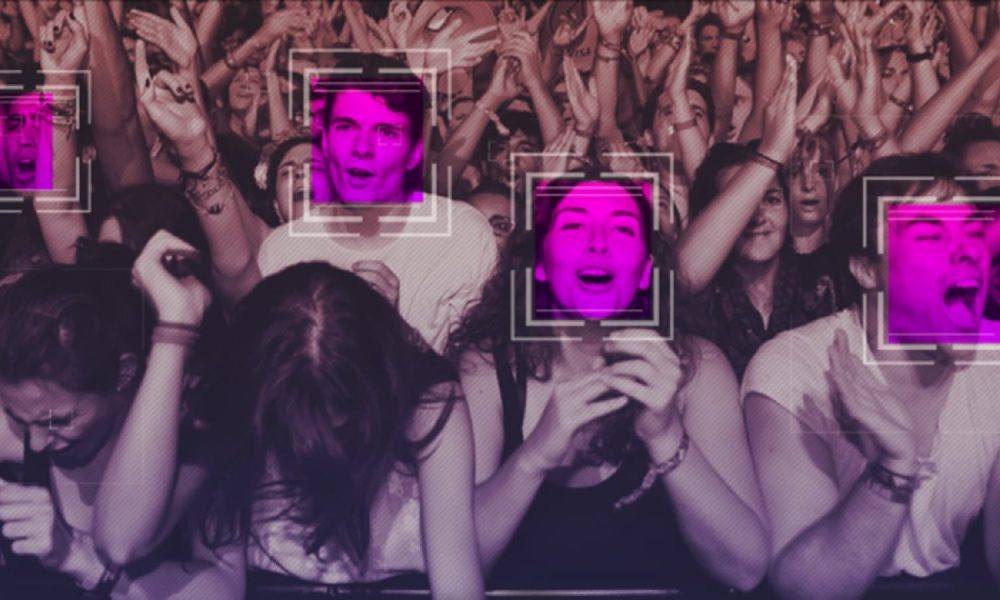

Of misschien kunnen we de boel een beetje verknoeien en wat gezichtsherkenningssoftware voor de gek houden. Ja, dat zal ze laten zien. Nou eigenlijk zal het wel. En de genieën van het SAND Lab van de Universiteit van Chicago zijn druk bezig geweest met het ontwikkelen van dat plan. Dat wil zeggen, een programma – Fawkes – is gearriveerd om een hoop buskruit te laten ontploffen recht onder de stoel van Clearview AI.

grote broer kijkt

Afbeelding: Unsplash

We weten allemaal dat we bijna 24 uur per dag, 7 dagen per week worden bewaakt. Als je over straat loopt, kijken de camera’s je aan. Als je een winkel binnengaat, houden camera’s je in de gaten. Als je naar je smartphone kijkt, is het waar, de camera’s kijken naar jou. Waar we ook gaan, het lijkt erop dat camera’s al onze bewegingen vastleggen. En niet alleen dat, ze stelen ook je gezicht. Gezichtsherkenning kan voor verschillende dingen worden gebruikt, van het identificeren van u (uiteraard) tot het gebruik van uw afbeelding in deepfake-video’s en apps. Dit is de reden waarom onderzoekers van de Universiteit van Chicago zo graag de vloedgolf van beruchte AI willen stoppen.

Als dit een publiekvriendelijke app zou worden, zoals de ontwikkelaars (uiteindelijk) van plan zijn, zou dit Clearview AI kunnen stoppen. Dat kan alleen maar goed zijn, toch? Het is ontworpen om te worden gebruikt met elke gewone foto. U hoeft alleen maar de afbeelding door de app te laten lopen en vervolgens kunt u deze delen zoals u dat normaal zou doen.

Hoe handelt Fawkes?

Afbeelding: Ahmed Zayan op Unsplash

De software van Fawkes werkt door het beeld heel licht te veranderen. Het is niet genoeg dat mensen het kunnen detecteren. Deze wijzigingen worden aangebracht op pixelniveau en zijn zeer subtiel. Ze zijn echter voldoende om gezichtsherkenningssoftware te verwarren. Onderzoekers hebben dit proces “image cloaking” genoemd en het creëert een ander beeld, dat niet te onderscheiden is door te kijken.

Ze leggen het als volgt uit: “Het verschil… is dat als iemand deze foto’s probeert te gebruiken om een gezichtsherkenningsmodel te bouwen, de “verborgen” afbeeldingen het model een sterk vervormde versie zullen leren van wat jou op jou laat lijken. Het laageffect is niet gemakkelijk te detecteren door mensen of machines en zal geen fouten veroorzaken in modeltraining. Wanneer iemand u echter probeert te identificeren door een ongewijzigd en onverholen beeld van uzelf (bijvoorbeeld een in het openbaar gemaakte foto) aan het model te presenteren, zal het model u niet herkennen.”

De toekomst van AI-gezichtsherkenning

Het lijkt er dus op dat we ons leven kunnen voortzetten als de werkmieren die we nauwelijks zijn. Behalve dat we ons nu geen zorgen hoeven te maken over een of andere vreselijke deepfake-crisis die voor onze deur komt. Nou, we kunnen ons sowieso wat minder zorgen maken.

Goed gedaan voor de onderzoekers van de SAND Laboratories van de Universiteit van Chicago. Dit is een stap voorwaarts in de strijd tegen de totale verdwijning van onze vrijheden. Ik vraag me echter af of er een manier is om te voorkomen dat Elon Musk verdomde U2 rechtstreeks op mijn hersenschors speelt.

Wat denk je? Maakt u zich zorgen over gezichtsherkenning? Laat het ons hieronder weten in de comments of neem de discussie mee naar onze Twitter of Facebook.

Aanbevelingen van de redactie: