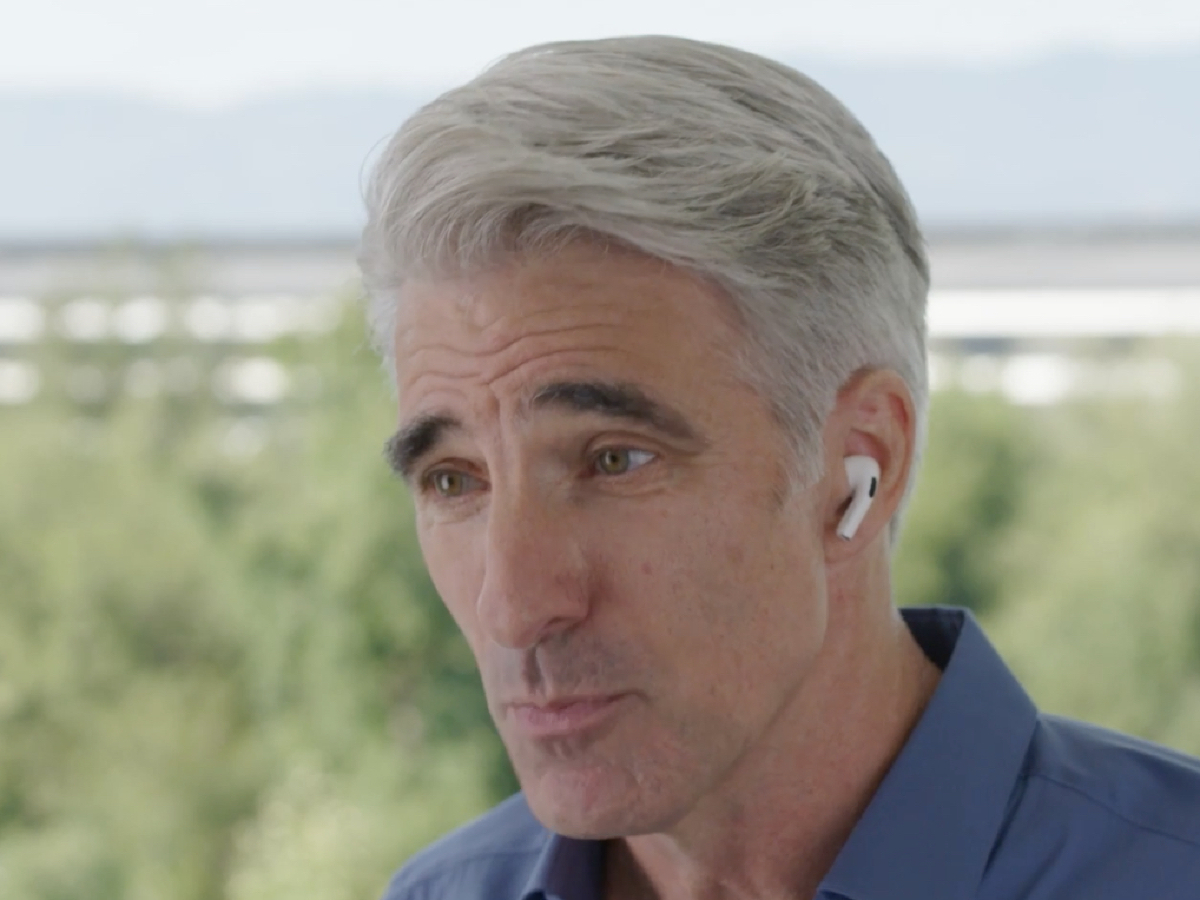

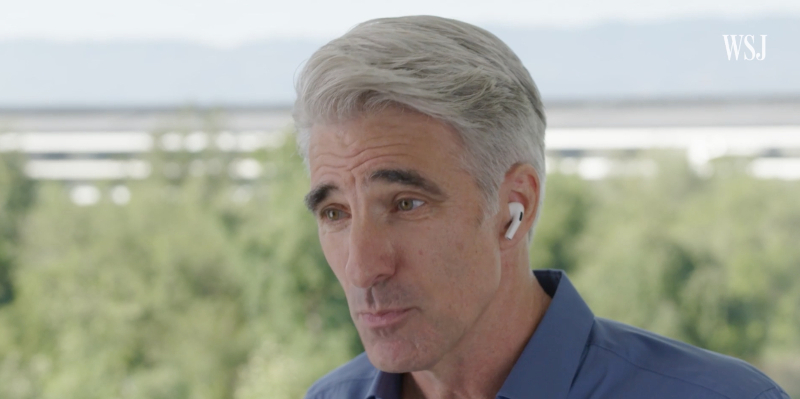

In een video-interview met Wall Street Journalkeerde Craig Federighi terug naar het controversiële onderwerp van nieuwe beveiligingsfuncties om kinderpornografie en kindermisbruik te voorkomen. Als de substantie niet in twijfel wordt getrokken, is het de vorm die een probleem vormt voor het publiek.

Proberen de debatten te kalmeren, SVP geeft toe dat de gelijktijdige aankondiging van beveiligingen via berichten en CSAM-analyse (het scannen van iPhone-fotobibliotheken) niet de gelukkigste was en voor verwarring had kunnen zorgen. De twee maatregelen lijken op elkaar, maar hun werking is nog steeds heel verschillend. En als het de communicatie rond deze tools lijkt te betreuren, blijft het geldig. We zijn erg trots op deze nieuwe tools. Maar ze zijn duidelijk verkeerd begrepen.

Verder leert Craig Federighi ons niet veel nieuwe dingen.. Bevestig dat alleen foto’s die naar iCloud zijn geüpload, worden gescand en dat de functie wordt uitgeschakeld als er geen back-up van foto’s naar iCloud wordt gemaakt.

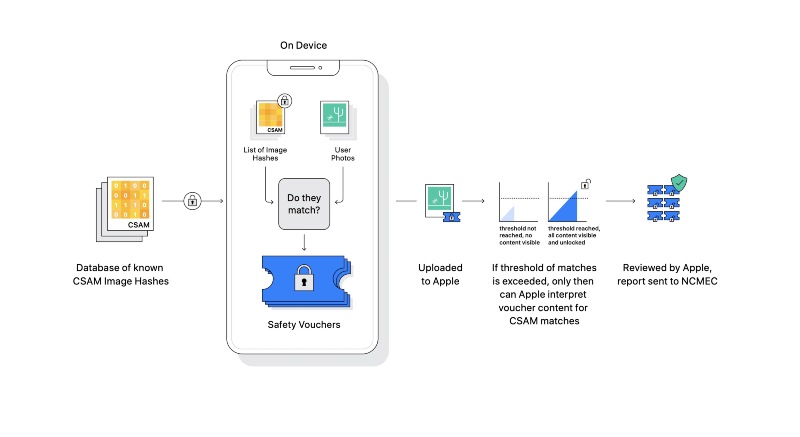

Laten we dat onthouden met deze neuralhash-technologie kunt u een afbeelding analyseren door middel van hashes en zeer nauwkeurige algoritmen gekoppeld aan een database. Het vergelijkt direct op het apparaat met de eigen foto’s van de gebruiker en markeert deze voordat ze worden geüpload naar iCloud-foto’s.

Als de match succesvol is, de foto krijgt een specifieke bladwijzer. Na een bepaald aantal, een team menselijk zal een speciale procedure controleren en toepassen, die bestaat uit het deactiveren van het account en het informeren van een geautoriseerd Centrum. De enige nauwkeurigheid is anders dan de hoogte van deze tolerantiedrempel, die Craig Federighi evalueert tot iets in de orde van 30 afbeeldingen.