Facebook heeft onlangs met ons gedeeld hoe zijn Community Standard werkt en heeft ook kort uiteengezet hoe het het sociale netwerk heeft geholpen bij het identificeren van berichten die als schadelijk en discriminerend worden beschouwd. Daarnaast heeft het bedrijf ons ook geïnformeerd over zijn monitoringactiviteiten van januari tot maart van dit jaar.

ADVERTENTIE

Statistisch meldde Facebook dat het 2,2 miljard nepaccounts had gedeactiveerd, minuten nadat de accounts waren aangemaakt. Hij vertelde ons onder andere dat hij 1,8 miljard spamberichten had verwijderd, 19,4 miljoen artikelen over naaktheid en seksuele activiteit voor volwassenen, 33,6 miljoen inhoud die als gewelddadig werd beschouwd en 6,4 miljoen artikelen met terroristische propaganda en extremistische artikelen.

Facebook wees er ook snel op dat de meeste van dergelijke berichten meer dan 90% van de tijd door zijn eigen bewakingstechnologie werden gemarkeerd. Het sociale netwerk zei echter ook dat hoewel zijn technologie in staat is om dat werk te doen, het ook de hulp van zijn gebruikers inroept om berichten te markeren en te rapporteren die als provocerend of provocerend van aard kunnen worden beschouwd.

Kort samengevat: de Facebook-gemeenschapsnormen omvatten drie basisprincipes in een lijst met regels. Deze principes zijn veiligheid, stem en eerlijkheid. Deze principes spreken voor zich; Het beveiligingsprincipe verwijst uiteraard naar uw beleid om de gemeenschap veilig te houden. Het principe van Voice verwijst naar de vrijheid die het platform zijn gebruikers biedt, terwijl het principe van Fairness ervoor zorgt dat het beleid van Facebook voor iedereen geldt, ongeacht ras, religie of cultuur.

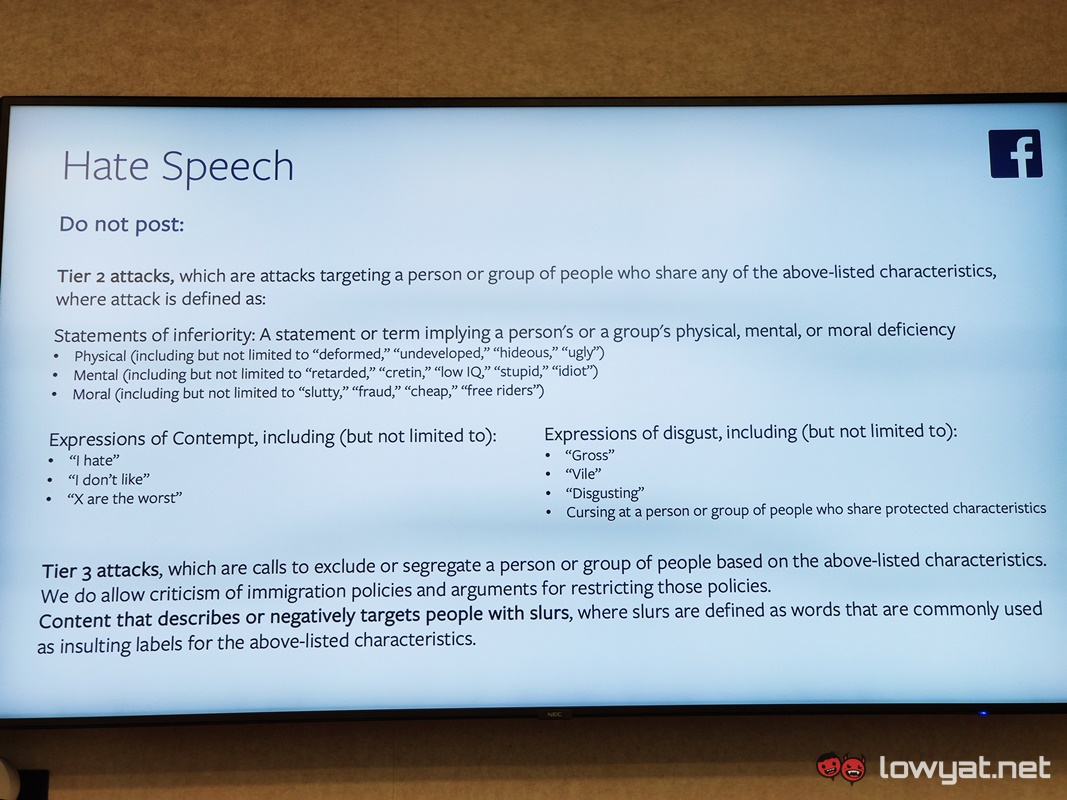

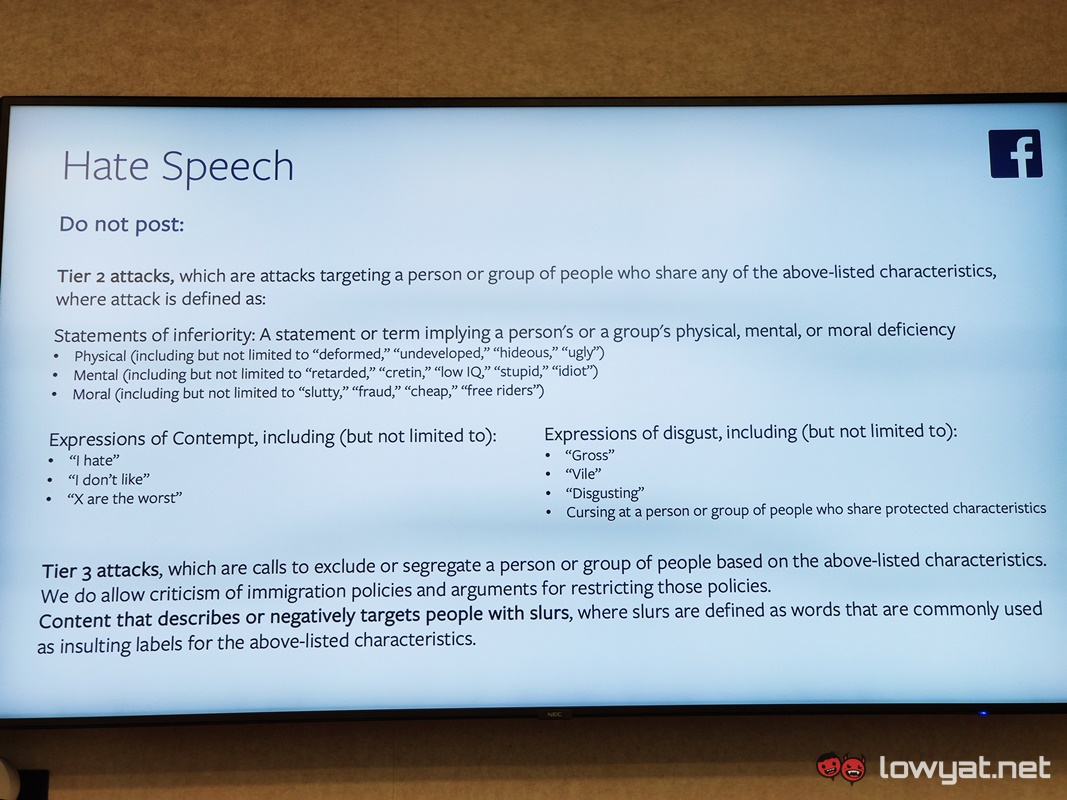

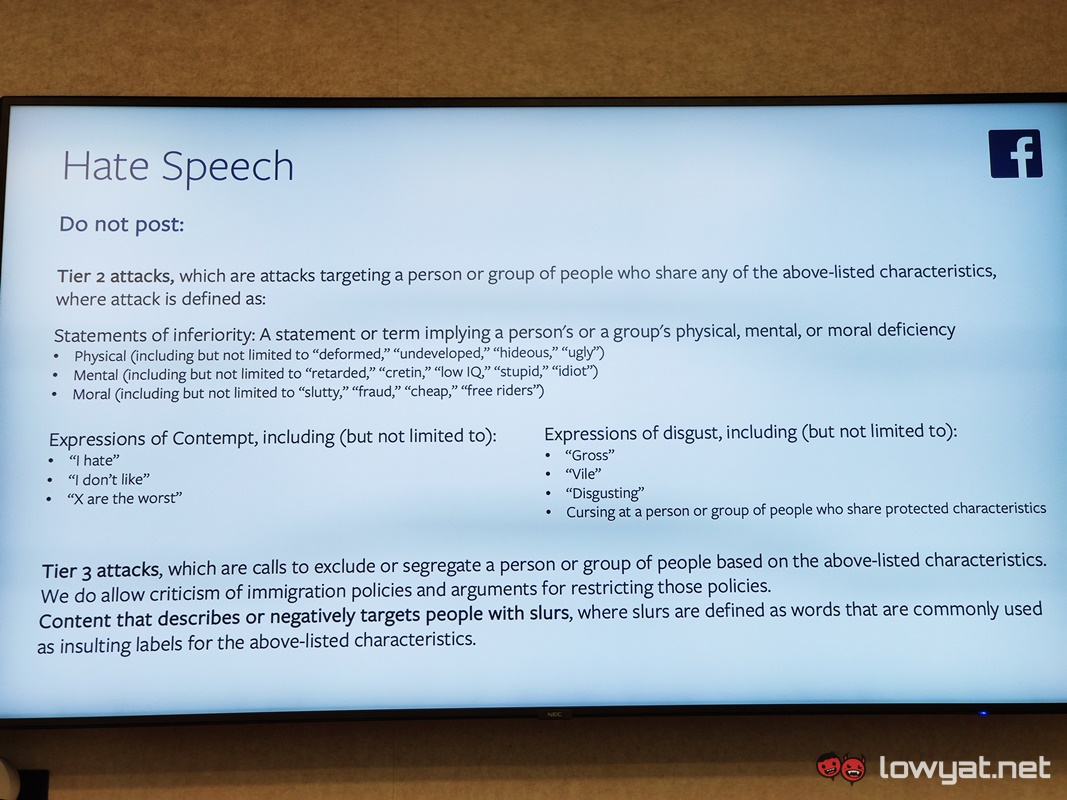

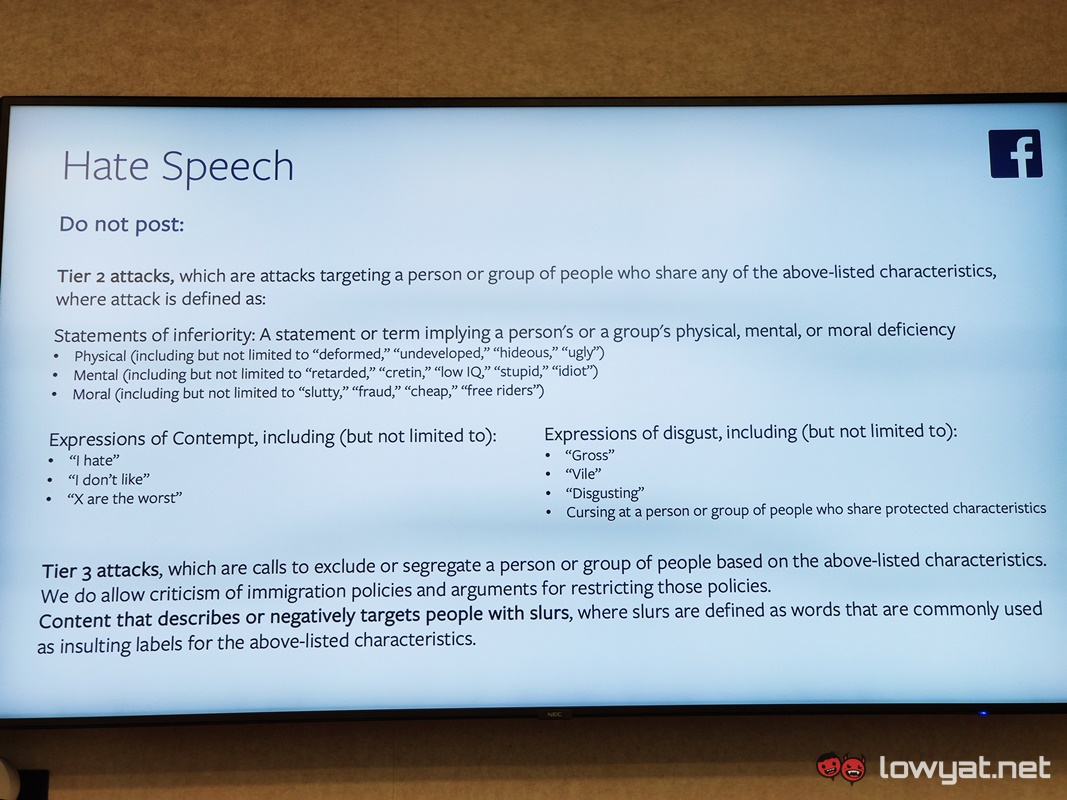

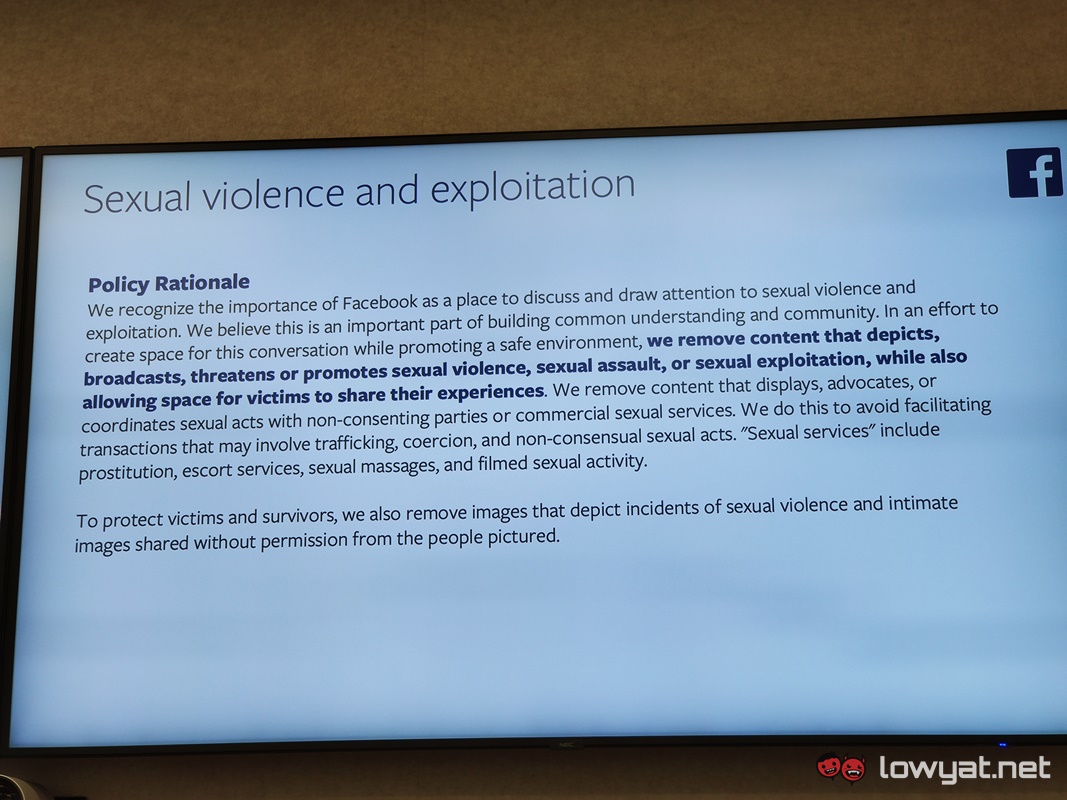

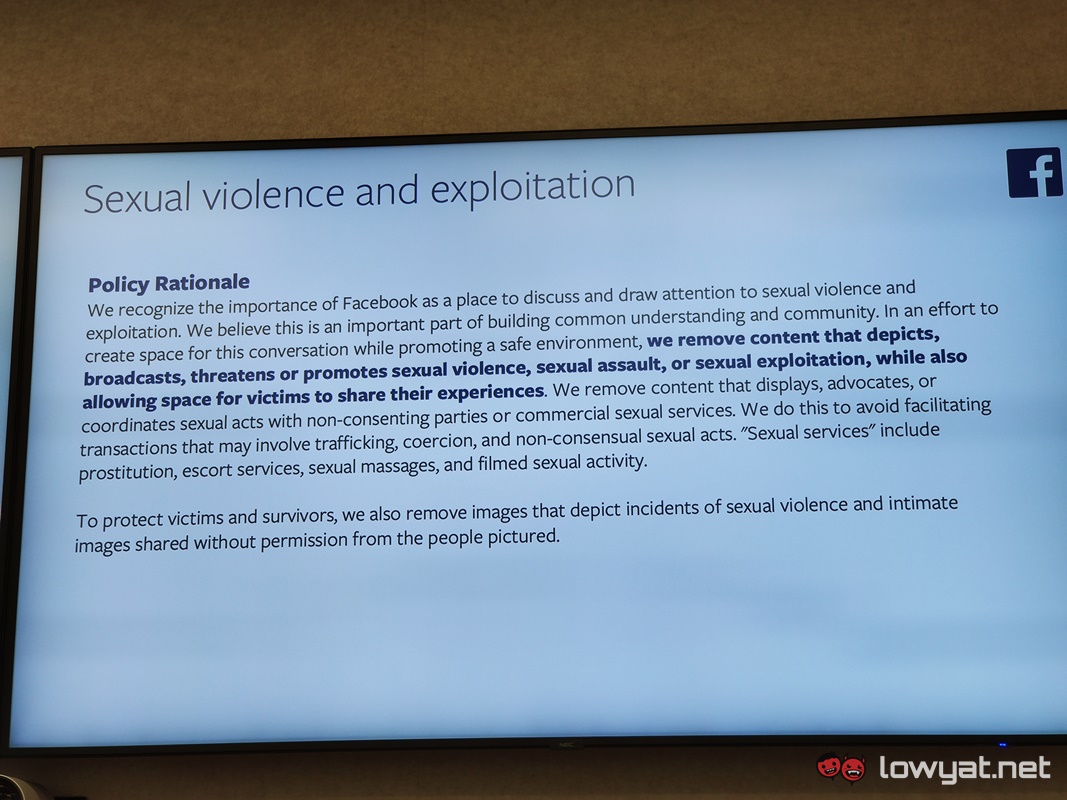

Facebook legde ook zijn communitynormen uit met betrekking tot haatzaaiende uitlatingen en berichten met betrekking tot seksueel geweld of uitbuiting. Wat dit laatste betreft, zegt Facebook dat zolang de afgebeelde inhoud “geen seksueel geweld, aanranding of seksuele uitbuiting overbrengt, bedreigt of bevordert”, AND gebruikers die het slachtoffer zijn van dergelijke handelingen in staat stelt hun ervaringen te delen, deze deze niet zal markeren. berichten. .

Het spreekt natuurlijk voor zich dat de grens tussen wat als acceptabel en onacceptabel wordt beschouwd een grijs gebied is, en soms is Facebook zich niet meteen bewust van het probleem. Maar, zoals hierboven vermeld, is dat ook de reden waarom het sociale-mediaplatform zijn gebruikers de hand reikt om ongepaste berichten te markeren.